Meta AI espionne 500 millions d’utilisateurs dans le monde… Êtes-vous sur la liste ?

Une collecte de données à grande échelle révélée par Surfshark

Selon une récente étude de Surfshark, société spécialisée en cybersécurité et VPN, Meta AI récolterait déjà les données personnelles de 500 millions d’utilisateurs dans le monde. Ce chiffre, qui englobe aussi bien des informations techniques que des données hautement sensibles, place Meta AI en tête de liste des assistants intelligents les plus intrusifs. À l’heure où l’IA conversationnelle se généralise, cette pratique soulève d’importantes questions sur la vie privée et les usages commerciaux de nos échanges.

32 types de données sur 35 possibles

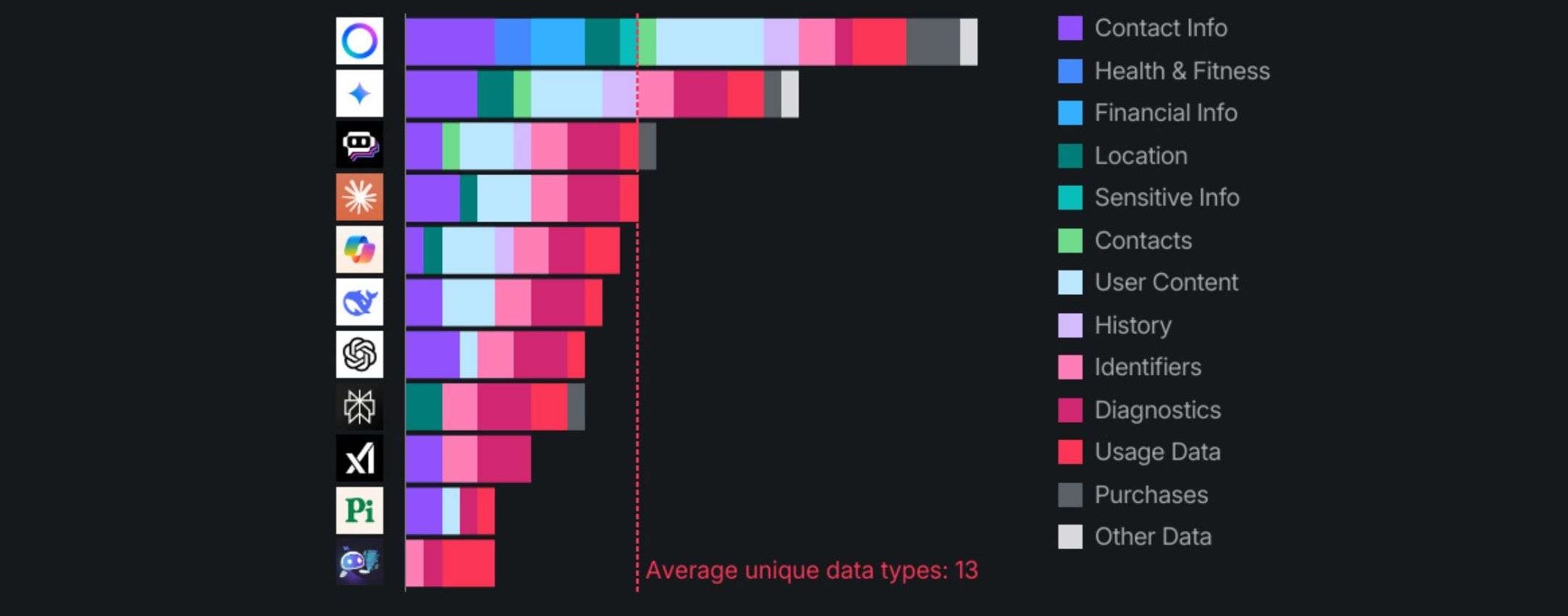

Le rapport de Surfshark dresse un panorama des dix principaux assistants IA du marché, en évaluant leur appétit pour 35 catégories de données. Meta AI apparaît comme un véritable glouton :

- Collecte de 32 types de données au total, contre une moyenne de 13 pour ses concurrents.

- Parmi ces données figurent :

- Informations d’identité (nom, adresse, contacts).

- Localisation géographique et historique de navigation.

- Données sensibles : état de santé, situation financière, orientation sexuelle, croyances religieuses, opinions politiques, données biométriques.

Contrairement à d’autres IA qui s’en tiennent à des informations techniques (type de terminal ou configuration réseau), Meta AI pénètre dans les sphères les plus intimes de ses utilisateurs.

Partage avec des tiers et profilage publicitaire

Si la plupart des assistants IA se contentent d’exploiter les échanges pour améliorer leurs modèles, Meta AI va plus loin : elle se réserve explicitement le droit de partager et de monétiser ces données auprès d’annonceurs et de partenaires tiers. Concrètement, chaque question posée et chaque phrase échangée avec Meta AI alimentent un « profil commercial » destiné à cibler la publicité de manière toujours plus précise.

Comparaison avec Google Gemini et ChatGPT

Parmi les challengers, Google Gemini récolte jusqu’à 22 catégories de données, dont la position GPS ou la liste de contacts, mais n’atteint pas la voracité de Meta. ChatGPT, l’assistant d’OpenAI, se limite, quant à lui, à 10 types de données et propose une option de « conservation temporaire » des échanges. Malgré tout, tous partagent une même faiblesse : ils vivent de nos données personnelles.

Risques accrus dans certaines juridictions

Au-delà des géants américains, certains acteurs comme DeepSeek hébergent leurs serveurs en Chine, où l’État peut accéder aux données sans décision judiciaire. Associé à une politique de sécurité parfois défaillante et à des incidents antérieurs, cet aspect rend l’usage de tels services particulièrement risqué pour les utilisateurs étrangers.

Les autres appétits de l’IA conversationnelle

Outre Meta, d’autres chatbots affichent un comportement discutable :

- Jasper et Poe : collectent des métadonnées de navigation et des identifiants de dispositifs.

- Copilot (technologies Microsoft) : récupère l’historique d’utilisation et peut croiser ces informations avec d’autres services.

Ces données, une fois croisées, enrichissent des fichiers de « data brokers » ou alimentent des campagnes de marketing ciblé sans que l’utilisateur n’en ait pleinement conscience.

Vie privée et IA : un équilibre encore introuvable

L’analyse de Surfshark démontre qu’aucun assistant IA n’échappe au besoin de données personnelles pour fonctionner. Certains optent pour une collecte plus limitée, mais se perdent ensuite dans des politiques de confidentialité floues. D’autres se veulent transparents, tout en opérant dans des zones grises du droit.

Un appel à la régulation et à la vigilance

L’explosion des usages de l’IA nécessite un encadrement législatif strict et des garanties techniques renforcées. Les principaux points d’attention sont :

- Mise en place de limites claires sur les catégories de données autorisées.

- Obligation de transparence sur la durée de conservation des échanges et leur réutilisation commerciale.

- Création d’un label « IA respectueuse de la vie privée » contrôlé par des tiers indépendants.

- Possibilité pour les utilisateurs de consulter et de supprimer intégralement leurs données collectées.

En attendant, chaque utilisateur doit garder en tête que ses conversations avec un assistant IA sont farcies de données exploitables. Avant de partager un élément intime ou une information jugée sensible, il peut être utile de se demander : « Suis-je prêt à ce que cela finisse dans un dossier publicitaire ? »

Perspective : vers une IA « éthique » ou un contrôle renforcé ?

Pour que l’IA devienne véritablement bénéfique, deux voies se dessinent : la bonne volonté des entreprises tech ou un arsenal juridique robuste. Sans l’un ni l’autre, nous restons à la merci de géants comme Meta, dont l’économie repose sur l’extraction et la valorisation de « notre » matière première la plus précieuse : les données.