Anthropic retrouve la Maison‑Blanche : la paix signée autour de Claude Mythos ? Ce que cache la réunion secrète

Anthropic et la Maison‑Blanche : vers un apaisement stratégique autour de Claude Mythos

Un rapprochement discret mais significatif s’est tenu hier soir à la Maison‑Blanche : Dario Amodei, le PDG d’Anthropic, a rencontré plusieurs responsables de l’administration américaine — dont le chef de cabinet Susie Wiles et le secrétaire au Trésor Scott Bessent — pour évoquer les modalités d’une éventuelle coopération autour du nouveau modèle d’IA de la start‑up, Claude Mythos. L’événement marque un tournant possible après des semaines de tensions politiques et de restrictions, et illustre la complexité des relations entre pouvoir public et acteurs majeurs de l’intelligence artificielle.

Contexte : un modèle controversé et des intérêts divergents

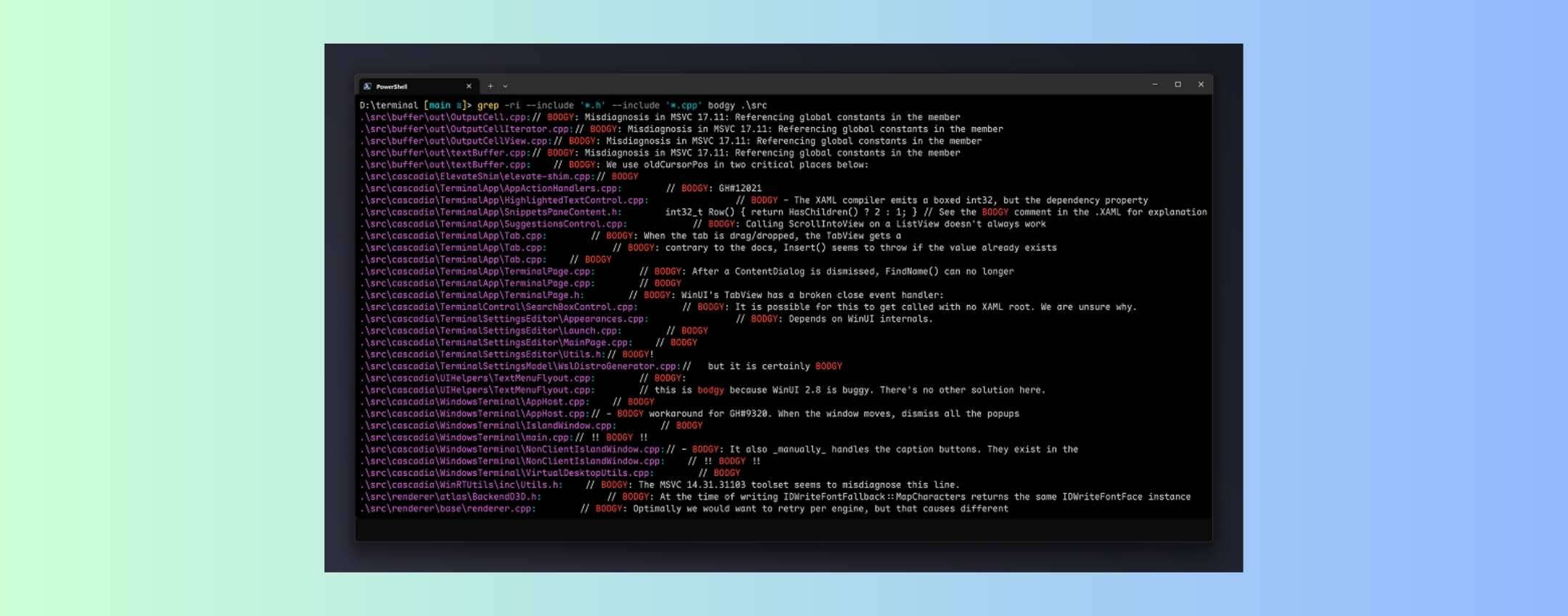

Claude Mythos n’est pas un modèle comme les autres : présenté par Anthropic comme une plateforme puissante destinée à des usages professionnels, il a été accueilli avec prudence par plusieurs branches de l’administration. Le Department of Defense a, notamment, inscrit Anthropic sur une liste noire interne en raison d’inquiétudes sécuritaires — décision qui a alimenté un litige politique et juridique. Parallèlement, d’autres agences fédérales voient dans Claude Mythos une opportunité technique pour renforcer leurs capacités, notamment en matière de cybersécurité.

Un dialogue pragmatique centré sur la cybersécurité

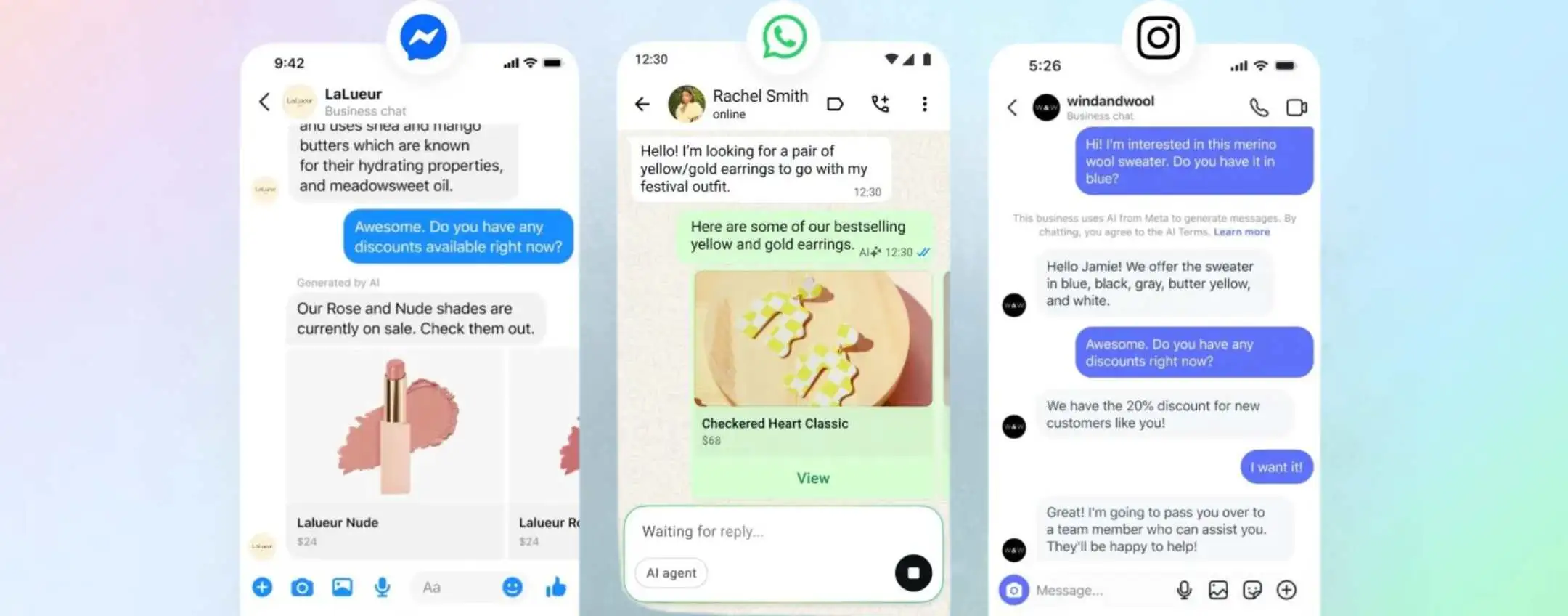

Selon les éléments communiqués après la réunion, le ton du rendez‑vous a été « productif et constructif ». Les participants ont discuté des modalités d’accès au modèle par le biais du Project Glasswing, un programme pilote qui donne déjà un accès limité à des partenaires triés sur le volet (entreprises, banques et organismes divers). L’un des points d’accord potentiels porte sur l’utilisation de Claude Mythos pour détecter et anticiper des vulnérabilités dans les systèmes informatiques gouvernementaux — une mission qui plaide pour une collaboration technique encadrée plutôt qu’une confrontation politique.

Une convergence d’intérêts, sauf sur la Défense

Un fait saute aux yeux : la quasi‑totalité des agences fédérales aurait exprimé son intérêt pour tester le modèle, à l’exception notable du Department of Defense. Cette divergence illustre la fracture interne au sein de l’exécutif sur la manière d’appréhender les produits d’IA développés par le secteur privé : d’un côté, des entités pragmatiques soucieuses d’améliorer leur résilience numérique ; de l’autre, des services pour qui la provenance technologique et les risques d’appropriation étrangère sont des signaux d’alerte.

Quelles garanties pour rassurer Washington ?

Le succès d’un dialogue pérenne dépendra pour beaucoup des garanties proposées par Anthropic. Trois axes apparaissent essentiels :

Le président informé… ou pas ?

La communication autour de la réunion laisse également transparaître un autre aspect politique : d’après les comptes‑rendus, le président n’aurait pas été directement informé du contenu exact de ces échanges. Cette configuration traduit la réalité d’une administration où les arbitrages technologiques et sécuritaires peuvent être portés à différents niveaux, parfois sans remonter au sommet. Cela pose la question de la stratégie globale des États‑Unis vis‑à‑vis de l’écosystème IA : centralisée ou fragmentée entre agences ?

Anthropic face à la défiance : enjeux commerciaux et souverains

Pour Anthropic, l’enjeu est double. D’un point de vue commercial, obtenir l’aval d’agences fédérales ouvre des perspectives de déploiement et de légitimité, surtout face à des concurrents bien implantés. Sur le plan géopolitique, l’entreprise doit naviguer entre la nécessité d’innover et les suspicions liées à la sécurité nationale, dans un contexte où la course à l’IA est devenue un élément clé de la compétition entre grandes puissances.

Les conséquences pour l’écosystème IA américain

Si ce rapprochement se concrétise, il pourrait instaurer un précédent : des collaborations encadrées entre administration et acteurs privés pour tirer parti des capacités d’IA tout en limitant les risques. Mais il pourrait aussi raviver des tensions, notamment si les agences concernées constatent des failles, ou si d’autres départements — wie la Défense — maintiennent une position antagoniste forte.

À court terme : suivi et transparence

Les prochains jours seront donc déterminants. Il faudra observer :

Au‑delà de l’affaire Anthropic, ce moment illustre une réalité plus large : la technologie avance vite et les institutions publiques cherchent encore les cadres efficaces pour gouverner l’IA. L’équilibre entre innovation et sécurité reste fragile — et chaque pas vers la coopération devra s’accompagner d’une transparence et d’un contrôle renforcés.