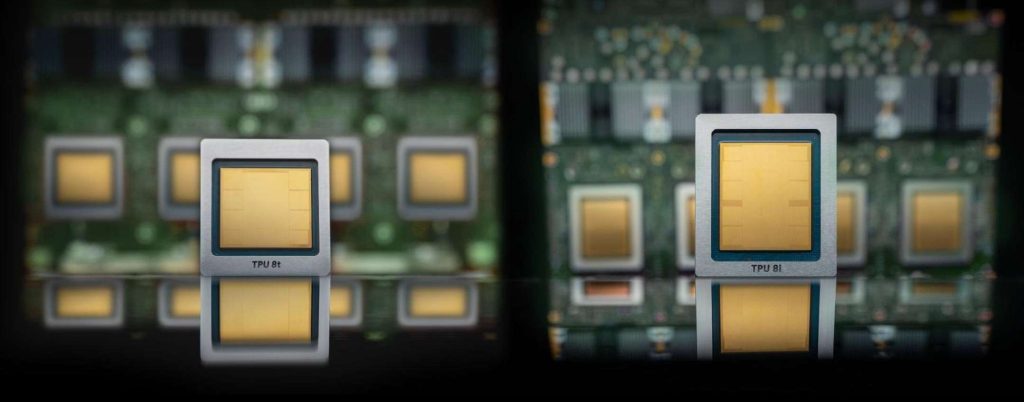

TPU 8t et 8i : Google plaide pour une infrastructure IA taillée pour l’ère des « agents »

Lors de son événement Cloud Next, Google a levé le voile sur deux nouvelles générations de puces dédiées à l’intelligence artificielle : les TPU 8t et TPU 8i. Présentées comme la réponse technique à la montée en puissance des « agents » IA — ces systèmes capables d’exécuter des tâches complexes de façon autonome et parallèle — ces unités de traitement promettent des sauts spectaculaires de performances tout en améliorant l’efficacité énergétique. Pour les acteurs qui développent ou exploitent des modèles de grande taille (dont Gemini), ces annonces redessinent l’horizon de la puissance de calcul disponible.

Deux puces, deux métiers : entraînement vs. inférence

Google distingue clairement deux usages avec ces TPU : l’entraînement massif et l’inférence à haute concurrence.

Performances et innovations matérielles

Les gains techniques annoncés sont importants et reposent sur plusieurs leviers :

Échelle industrielle : superpods et modularité

Google a pensé ces TPU pour un déploiement massif. Les superpods — grappes de milliers de puces interconnectées — permettent d’atteindre des capacités d’entraînement auparavant réservées à quelques acteurs. L’augmentation de la taille des superpods et de la bande passante devrait réduire les temps d’entraînement des modèles de très grande taille et faciliter l’expérimentation à l’échelle des architectures agentiques complexes (multi‑tâches, multi‑modalité, chaînes de raisonnement).

Impacts pour les modèles « agentiques »

Pourquoi ces puces sont‑elles censées changer la donne pour les agents IA ? Les agents fonctionnent par composition : plusieurs sous‑modules (planification, mémoire à long terme, apprentissage en ligne, exécution d’actions) doivent coopérer, souvent en parallèle, pour accomplir des tâches complexes. Cette architecture impose trois exigences :

Les TPU 8t et 8i répondent explicitement à ces exigences : plus de mémoire HBM pour l’inférence, interconnexions plus rapides pour l’entraînement distribué et gestion de la consommation pour opérer à l’échelle sans multiplier les coûts énergétiques de façon proportionnelle.

Calendrier et disponibilité

Google annonce une disponibilité commerciale d’ici la fin de 2026. Les puces seront intégrées aux infrastructures Cloud de Google et mises à disposition des équipes internes pour Gemini, mais aussi proposées à des clients tiers via les offres Cloud. Cette stratégie relève d’une double logique : renforcer l’attractivité du cloud Google pour les développeurs IA et garantir à Google le contrôle de l’écosystème d’entraînement des modèles de nouvelle génération.

Conséquences pour l’écosystème IA

Plusieurs effets devraient se produire à moyen terme :

Questions et limites à garder en tête

Pour autant, tout n’est pas résolu par l’arrivée de nouvelles TPU :

Que surveiller maintenant ?

Avec les TPU 8t et 8i, Google parie sur une infrastructure taillée pour des agents toujours plus puissants et distribués. La promesse technique est solide : plus de mémoire, plus de bande passante, plus d’efficacité. Reste à voir si ces avancées matérielles se traduiront rapidement par des modèles d’IA plus sûrs, plus utiles et réellement déployables à grande échelle — ou si elles alimenteront une nouvelle phase d’accélération où la capacité de calcul restera l’apanage de quelques acteurs majeurs.